Roadmap AI Engineer em 90 dias: do dev backend ao primeiro agente em produção

A maioria dos roadmaps de "como ser engenheiro de IA" começa do mesmo jeito: aprenda Python, depois NumPy, depois PyTorch, depois um curso de cálculo. Para quem nunca programou faz sentido. Para você, que já entrega software em produção há anos, é desperdício de seis meses.

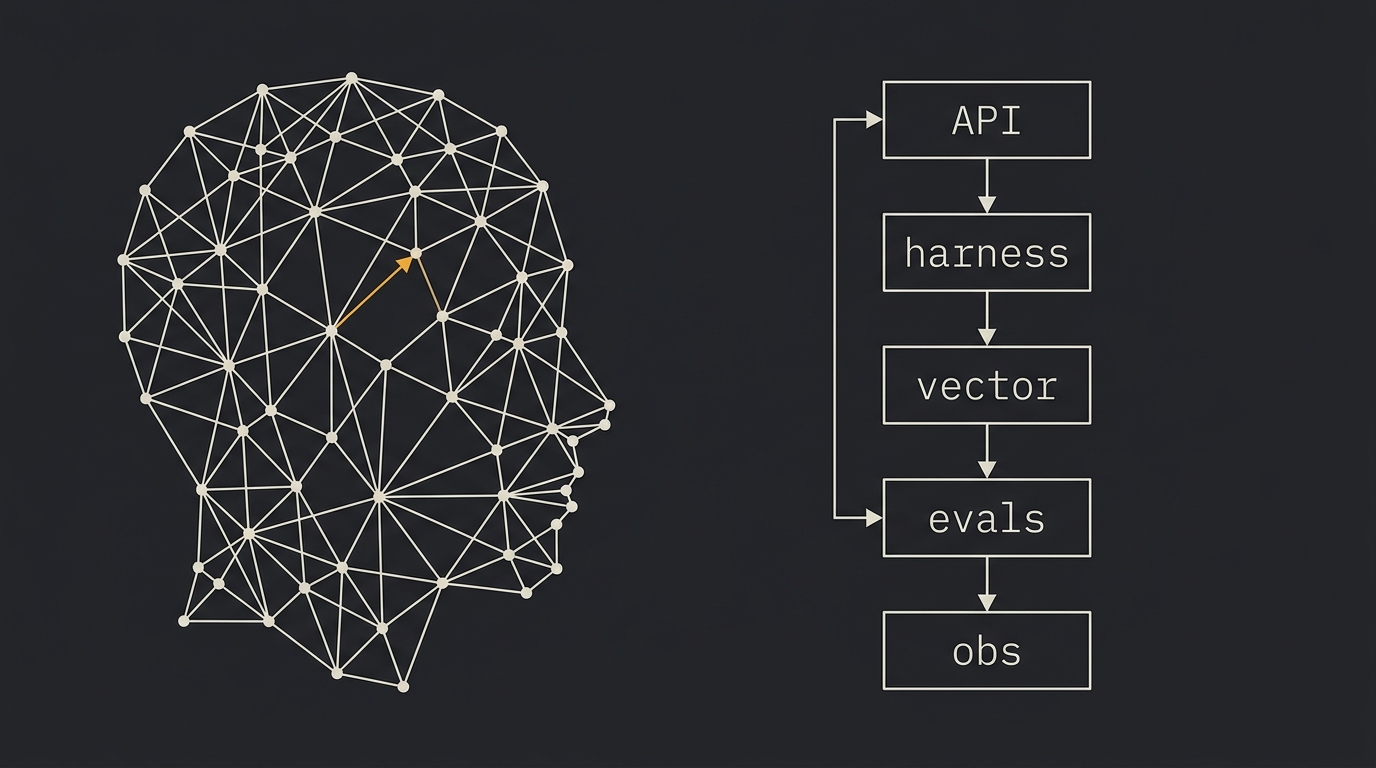

Engenheiro de IA aplicada não é um cientista de ML que treina modelo do zero. É um dev que sabe orquestrar modelo, contexto, ferramentas, dado e avaliação dentro de um produto que aguenta usuário real. O músculo que falta no dev backend não é matemática. É um conjunto novo de primitivos: tool use, RAG, memória, evals, observabilidade de agente.

Este post é o caminho real em 13 semanas — com entregável por semana, milestone que cabe no portfólio e foco em coisa que recrutador olha. Sem revisar o que você já sabe, sem detour por framework da moda.

TL;DR

- O que é: plano de 90 dias para dev experiente virar AI engineer aplicada, com foco em produto e portfólio.

- Stack sugerida: Laravel (PHP 8.3+) ou Node 20+ no harness, Python só onde for inevitável, Claude/OpenAI/Gemini via API, Postgres com pgvector ou Qdrant.

- Custo: entre 30 e 80 dólares por mês de API durante o estudo. Modelo open-source via Ollama/llama.cpp para experimentos locais.

- Entrega final: três projetos no GitHub, um deles fim-a-fim em produção, prontos para defender em entrevista.

- Referência de hiring real: o ai-engineering-field-guide do Alexey Grigorev cataloga assignments e take-home challenges de Q4 2025 / Q1 2026 — vale como bússola do que o mercado pede.

Por que o roadmap padrão te trai

O dev backend já tem 80% do que precisa.

Você modela domínio. Sabe ler API. Tem ferro de produção: deploy, log, fila, banco, fila, cache, fila de novo. Quando o roadmap genérico te manda revisar fundamentos por meses, ele está te tratando como quem nunca abriu um terminal.

E aí chega na entrevista de AI engineer e o que cobram não é PyTorch. Cobram: como você orquestra contexto num agente longo, como evita alucinação em RAG, como mede regressão em prompt, como debuga uma cadeia de tool calls que falhou na quinta iteração.

Tem dado nisso. O bootcamp do Codebasics, por exemplo, reporta que dev experiente faz a transição em cerca de 75 dias, em fins de semana, justamente porque a base de software já está dada. O gargalo está nas primitivas novas, não no Python.

A tese aqui é mais agressiva: você não precisa nem do Python como linguagem-mãe. Precisa do conceito. Pode operar em Laravel, em Node, em Go. O modelo não liga.

Pré-requisito: o que assumir e o que não vale revisar

Assuma que você tem:

- Domínio de uma linguagem backend (PHP, Node, Go, Java, Python — tanto faz).

- HTTP, JSON, REST e o básico de async/await ou equivalente.

- Git, Docker, deploy em alguma cloud, leitura de log.

- Capacidade de ler documentação em inglês sem tradutor.

Não vale revisar:

- Estrutura de dados básica.

- Padrão de projeto que você já usa todo dia.

- Cálculo, álgebra linear, estatística além do que você lembra do colegial.

- Treinar modelo do zero. Nenhum AI engineer de produto faz isso.

Se você tem dúvida real sobre o que é embedding, token, contexto, temperatura ou top-p, leia a visão geral de tool use da Anthropic num fim de semana. É o suficiente para começar a Semana 1.

Semanas 1–2: tool use e function calling sem framework

Antes de tocar em LangChain, LlamaIndex ou qualquer abstração, escreva tool calling na mão.

Entregável da Semana 1: um script que chama Claude (ou GPT) com três ferramentas declaradas — uma que lê um arquivo, uma que faz uma chamada HTTP, uma que insere num banco. Sem framework. Direto na API.

$response = $client->messages()->create([

'model' => 'claude-sonnet-4-6',

'tools' => [

['name' => 'read_file', 'input_schema' => [...]],

['name' => 'fetch_url', 'input_schema' => [...]],

['name' => 'insert_row', 'input_schema' => [...]],

],

'messages' => [['role' => 'user', 'content' => $prompt]],

]);

O ponto não é o snippet em si. É você sentir, com as mãos, o ciclo: o modelo devolve tool_use, você executa a função real, manda de volta como tool_result, o modelo decide o próximo passo. Quando esse loop estiver natural, framework deixa de ser mágica e vira conveniência.

Entregável da Semana 2: o mesmo script, agora num loop que itera até o modelo devolver resposta final. Trate erro de tool, limite o número de iterações, registre cada passo num log estruturado. Aqui você está construindo a célula básica de qualquer agente.

Leitura obrigatória: o post da Anthropic sobre advanced tool use, que apresenta Tool Search Tool e Programmatic Tool Calling — duas técnicas que evitam estourar contexto quando você tem dezenas de ferramentas.

Semanas 3–5: harness próprio em Laravel ou Node

Aqui o jogo muda. Você passa de quem chama API para quem orquestra agente.

Harness é o nome técnico para o invólucro que segura o agente em produção: gerência de turnos, controle de contexto, persistência de estado, política de retry, kill switch. É o que separa um script bonito de um sistema que aguenta usuário pagante.

Entregável da Semana 3: classe AgentSession que recebe um prompt inicial, mantém o histórico, executa tool calls, persiste o estado num banco a cada turno e expõe um método resume($sessionId). Em Laravel, isso vira um Job + Eloquent. Em Node, uma classe + Prisma. Não importa o stack — importa o desenho.

Entregável da Semana 4: sua sessão precisa lidar com janela de contexto cheia. Implemente compactação automática: quando o histórico ultrapassar X tokens, sumarize o que aconteceu, mantenha as últimas N mensagens cruas e siga. Esse é o problema que derruba 90% dos protótipos quando saem do happy path.

Entregável da Semana 5: um endpoint HTTP que dispara uma sessão, retorna session_id e permite acompanhar via SSE ou polling. Um mini Claude Code seu, em PHP ou Node, rodando no seu servidor.

Esse é o tipo de exercício que muda o jeito como você lê documentação de SDK pra sempre — e é exatamente o que vamos destrinchar ao vivo no Harness Engineering com Claude Code, do loop autônomo ao agente em produção.

Para entender o estado da arte do que você está reconstruindo, vale ler o overview do Claude Agent SDK, que é o motor extraído do Claude Code e expõe exatamente os primitivos que você está implementando à mão.

Semanas 6–8: RAG e memória persistente

Tool use cuida do "agir". RAG e memória cuidam do "saber".

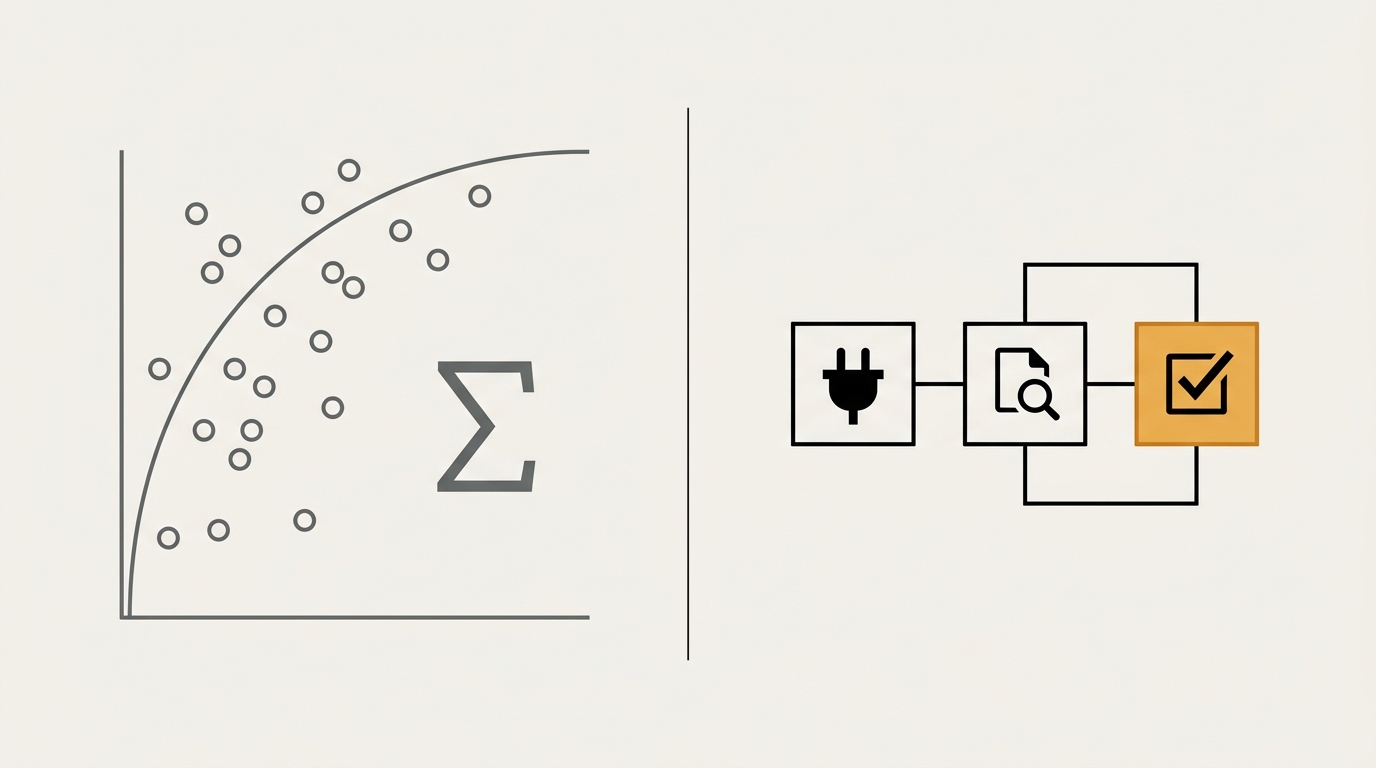

Entregável da Semana 6: um pipeline de ingestão. Pegue uma base sua — documentação, tickets antigos, um PDF longo — quebre em chunks com estratégia explícita (por seção, por título, por janela deslizante), gere embedding com um modelo barato (text-embedding-3-small da OpenAI ou equivalente) e grave em pgvector ou Qdrant. Versione o pipeline. Isso aqui é base de tudo.

Entregável da Semana 7: retrieval híbrido. Não fique só no cosseno. Combine busca vetorial com busca lexical (BM25) e re-rank com modelo dedicado (Cohere Rerank ou Voyage). Pesquisas recentes mostram que retrieval, não generation, é o gargalo da maioria dos sistemas RAG em 2026 — então é nele que você precisa investir.

Entregável da Semana 8: memória persistente do agente. Não confunda com RAG. Memória é o que o agente "lembra" de você entre sessões: preferências, decisões anteriores, fatos sobre o usuário. Implemente um esquema simples — user_memories com kind (preferência/fato/decisão), text, embedding, last_accessed_at — e uma policy de quando ler e quando escrever. Esse é o tipo de coisa que diferencia chatbot de produto.

Semanas 9–10: evals contínuos e observabilidade

A maioria dos devs pula essa parte e paga caro. Sem eval, qualquer mudança de prompt é apostar no escuro.

Entregável da Semana 9: um conjunto de 30–50 casos de teste do seu domínio, com input e expected output. Rode os casos contra duas versões do prompt e compare. Use LLM-as-judge para os casos subjetivos — outra chamada de modelo avalia se a resposta atende ao critério X. Plataformas como LangSmith e Braintrust resolvem o tracking, mas o conceito você precisa entender escrevendo na mão primeiro.

Entregável da Semana 10: observabilidade. Trace cada chamada de modelo (modelo, input, output, latência, custo, tokens), cada tool call (nome, input, output, sucesso/erro), cada turno de agente. Persista em algum lugar consultável. O padrão que está virando mainstream em 2026 é instrumentar via OpenTelemetry e mandar para uma plataforma de tracing de agente — Langfuse, Braintrust, Helicone, ou um stack próprio em ClickHouse.

A regra prática: 20–30% do esforço de um sistema de IA aplicada é eval e observabilidade. Quem entrega prompt sem isso está entregando hello-world.

Semanas 11–13: projeto fim-a-fim para o portfólio

Nada do que você fez até aqui aparece num GitHub público. Agora aparece.

Entregável da Semana 11: escolha um problema chato e específico do seu dia a dia. "Agente que lê meus issues do GitHub e me sugere prioridade." "Bot que faz triagem de currículos pra uma vaga específica." "Assistente que lê meu calendário e prepara briefing das reuniões da semana." Quanto mais nichado, melhor — porque obriga decisão real de produto.

Entregável da Semana 12: colocar de pé. Frontend simples (Livewire, Next, o que for mais rápido). Backend com seu harness. RAG se fizer sentido. Auth básico. Deploy numa VM ou Render/Fly.io. Tem que rodar publicamente com um link que você manda no LinkedIn.

Entregável da Semana 13: README sério. Explica o problema, a arquitetura (com diagrama), as decisões de modelo e por quê, o eval set, métricas observadas, custo médio por sessão e o que você faria diferente. Esse README é o que o tech lead vai ler antes da entrevista.

Hiring guides recentes batem nessa tecla: 3 a 5 projetos completos no GitHub valem mais do que diploma e quatro projetos com qualidade de produção batem 40 cursos concluídos em qualquer entrevista séria.

Como apresentar isso em entrevista

Recrutador técnico bom não vai te perguntar se você "sabe LangChain". Vai te dar um cenário.

"Desenhe um sistema de Q&A sobre 10 milhões de documentos com latência abaixo de 2s e custo abaixo de X centavos por query."

Se você fez as 13 semanas, sua resposta vem com decisão e tradeoff:

- Como chunkar (com motivo).

- Qual embedding (com benchmark).

- Vector index e estratégia de retrieval.

- Cache, re-rank, query routing.

- Como mediria qualidade em produção (eval set + LLM-as-judge + amostragem de trace).

- Estimativa de custo razoável.

Esse vocabulário não cai do céu. Cai de ter feito.

E quando vier o "fala de um projeto seu", você abre o repositório do Semana 13. Mostra o diagrama, mostra o eval set rodando, mostra o trace de uma sessão real. Acabou a entrevista.

FAQ

"Preciso mesmo aprender Python?"

Vale ler. Não vale virar sua linguagem principal se já tem outra. SDKs principais (Anthropic, OpenAI, Gemini) existem em TS e Python. Para Laravel/PHP tem prism-php e o anthropic-sdk-php. Você não precisa migrar de stack para fazer IA aplicada.

"E os frameworks tipo LangChain e LangGraph?"

Aprenda depois das Semanas 1–5. Quando você já entendeu o ciclo na mão, framework vira escolha consciente — você pega LangGraph porque resolve um problema concreto, não porque é o que aparece nos tutoriais.

"13 semanas dá mesmo para quem trabalha?"

Dá se você reservar 8–10 horas por semana com disciplina. Os entregáveis estão dimensionados para isso. Se cair para 4 horas, é mais realista pensar em 20–24 semanas. Não invente prazo que não cabe.

"Por onde começo se eu já fiz tool use?"

Pula para a Semana 3. Começa pelo harness. É lá que está o gap real entre quem escreve script e quem entrega produto.

Conclusão

Se você é dev backend experiente, o caminho mais curto para virar AI engineer não é refazer fundamentos. É construir, em ordem: tool use sem framework, harness próprio, RAG com retrieval híbrido, memória persistente, evals contínuos e um projeto fim-a-fim que dê para clicar.

Treze semanas é tempo de sobra para isso quando o roadmap respeita o que você já sabe. O que muda no seu portfólio, no seu vocabulário e na sua remuneração depois desse ciclo é o tipo de coisa que justifica o investimento.

O próximo passo do mercado vai ser ainda mais brutal: agente de longa duração, multi-agente, sistemas que aprendem da própria operação. Quem chega lá tendo construído a base à mão entende. Quem só plugou framework, não.

{AI Engineer} — apaixonado por Laravel, arquitetura de software e construir produtos com impacto. Compartilho aqui tutoriais, descobertas e reflexões sobre o dia a dia de engenharia.

Você também pode gostar

Engenheiro de IA em 2026: o que faz, e por que não é só usar ChatGPT no trabalho

Em 2024 era cargo inventado pelo LinkedIn. Em 2026 é o sênior mais disputado dos EUA. O que faz um Engenheiro de IA na prática: as 5 entregas em qualquer JD sênior, o stack típico (LLM API, harness, vector store, evals, observability) e por que a maioria veio de backend, não de Data Science.

Engenharia de IA não é Data Science: 7 diferenças que separam disciplina de hype

Recrutador chama as duas de "vaga de IA". CTO que confunde uma com a outra paga seis meses de retrabalho. Põe lado a lado data science e engenharia de IA em sete eixos: foco, métrica, stack, output, tempo de feedback, quem migra mais rápido e por que essa confusão atrasa carreira.

Como Implementar um Sistema de Recomendação Semântica no Laravel com Embeddings (Sem Tags, Sem Categorias)

Aprenda como construir um sistema de recomendação semântica real no Laravel, usando embeddings e PostgreSQL (pgvector) — sem depender de categorias, tags ou heurísticas frágeis.

Anatomia de um Agent Harness: state, tool execution, feedback loops e guardrails

Harness é o software que envolve o LLM e separa um demo bonito de um agente que aguenta produção. Quebro a anatomia em cinco peças obrigatórias: estado persistente, roteador de ferramentas, validação de I/O, loop de raciocínio e limites de segurança. É o mapa mental que abre a série de posts sobre engenharia de agentes.