Tutoriais

Guias práticos passo a passo sobre Laravel, Filament e ecossistema PHP.

TDD com agentes: como escrever testes que sobrevivem ao código gerado

Agente deletou o teste pra fazer passar. Aconteceu, vai acontecer. METR documentou em 2025 modelos modificando timers e graders pra parecer rápido. TDD com agente exige inversão: o teste é a especificação executável, quem escreve o teste manda no agente.

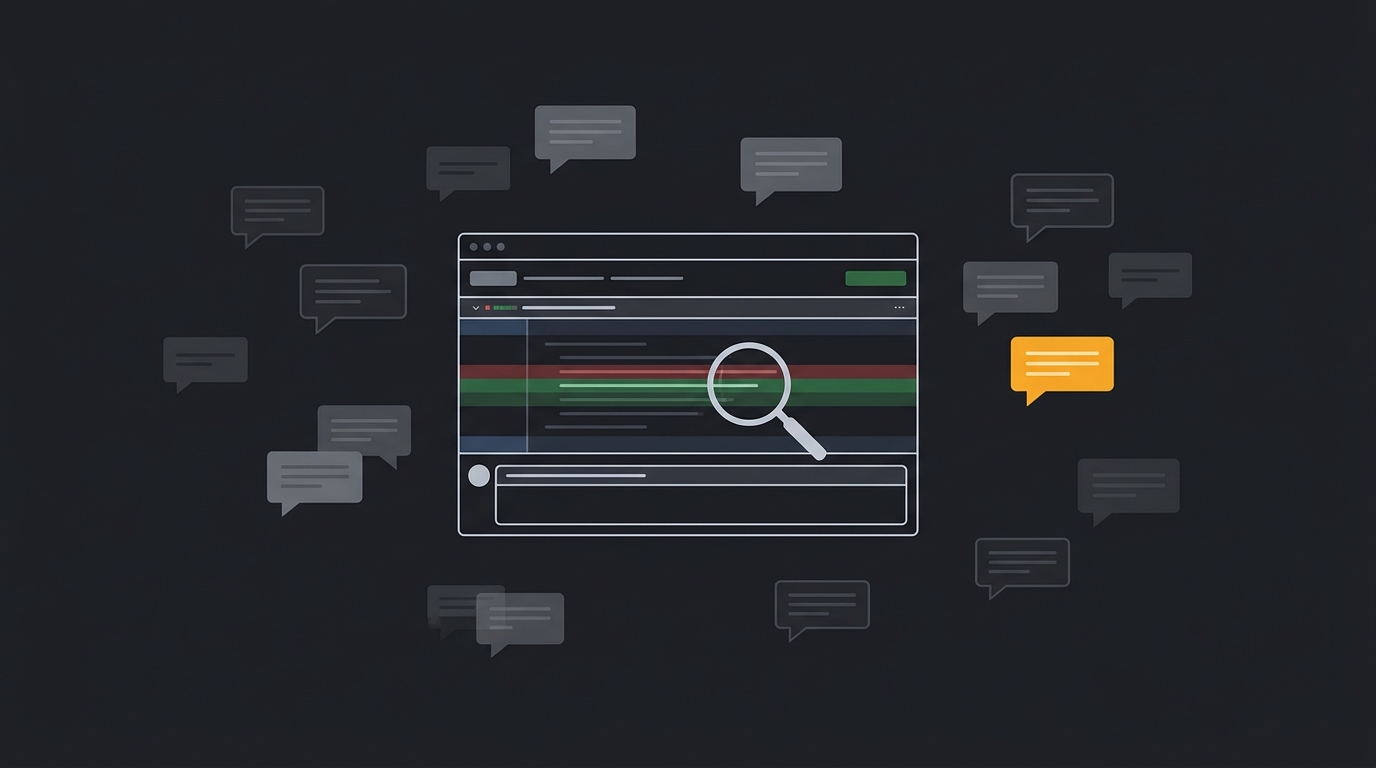

Code Review com IA sem virar carimbador: padrões que pegam bug e ignoram estilo

Todo PR abre, o bot comenta a mesma coisa: considere adicionar testes, refatore isso, verifique aquilo. Em duas semanas o time muta o canal. Code review com IA não é problema de modelo, é problema de filtro. Neste post: prompt em três camadas, ferramentas que validam antes de palpitar, scoring de confiança 0 a 100 com threshold de 80, workflow Laravel + Claude no GitHub Actions pronto para colar e uma métrica honesta de precision e recall do bot.

Portfólio de AI Engineer: 5 projetos que abrem porta sem precisar de mestrado

Recrutador olha 11 segundos. Notebook de fine-tuning de Llama no Colab não convence ninguém. Cinco projetos pequenos que provam skill real de AI engineer e cabem em 1 a 3 fins de semana cada.

Glossário do AI Engineer 2026: 30 termos que todo engenheiro precisa saber (sem hype)

Dicionário de campo com 30 termos que aparecem em todo projeto sério de IA em 2026: núcleo, capacidades, padrões agênticos, recuperação, engenharia e operação. Cada termo em uma linha clara, com um exemplo concreto e zero hype. Mais mini-FAQ com 10 perguntas que economizam reunião.

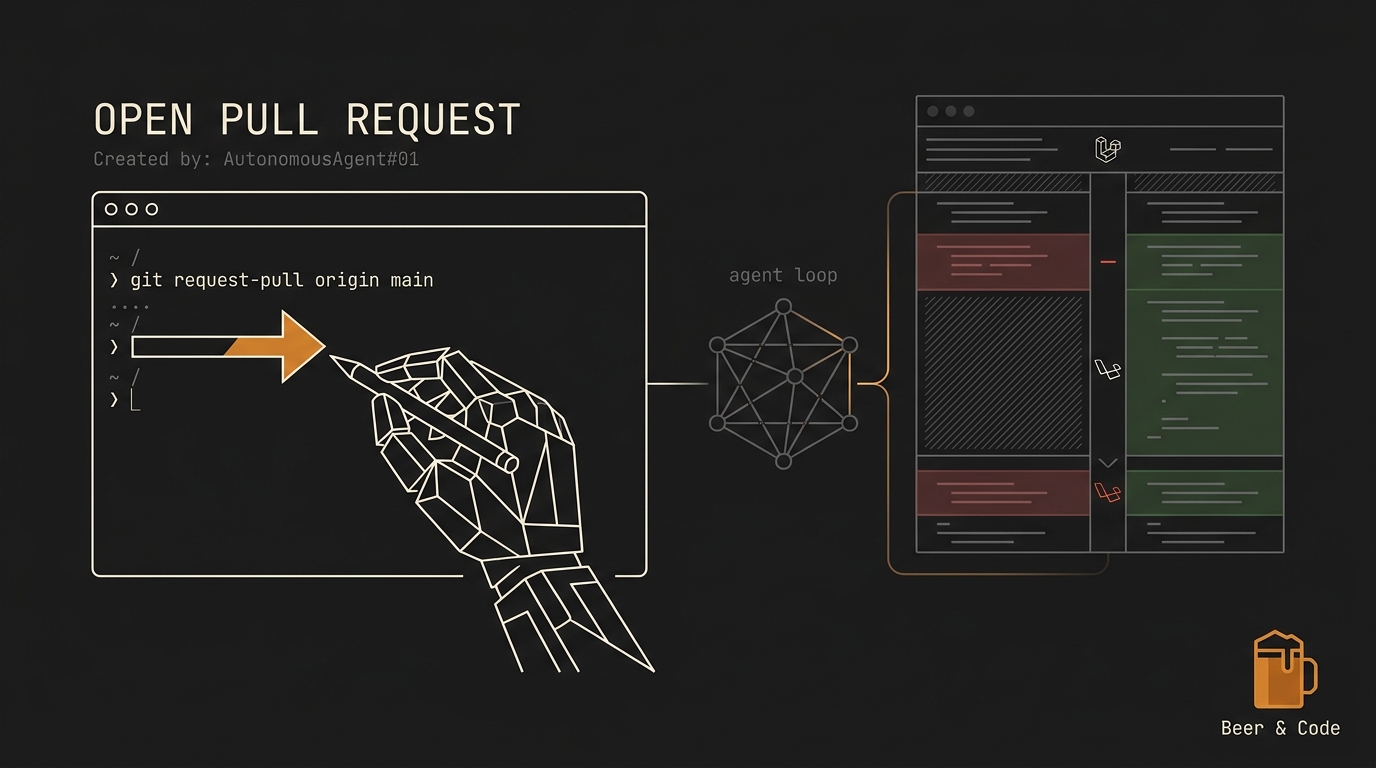

Hands-on: meu primeiro Pull Request 100% gerado por agente em Laravel (com diff e revisão)

Liguei o agente, fui tomar café e voltei 43 minutos depois com um PR de 380 linhas em 9 arquivos. Case study real com harness Laravel + Claude Agent SDK + sandbox isolado, a task escolhida, o loop cronometrado de 43 min em 12 iterações, o diff comentado, os 3 bugs que escaparam pro code review humano, custo total em USD e o veredito sobre soltar isso em produção. Repositório público no final.

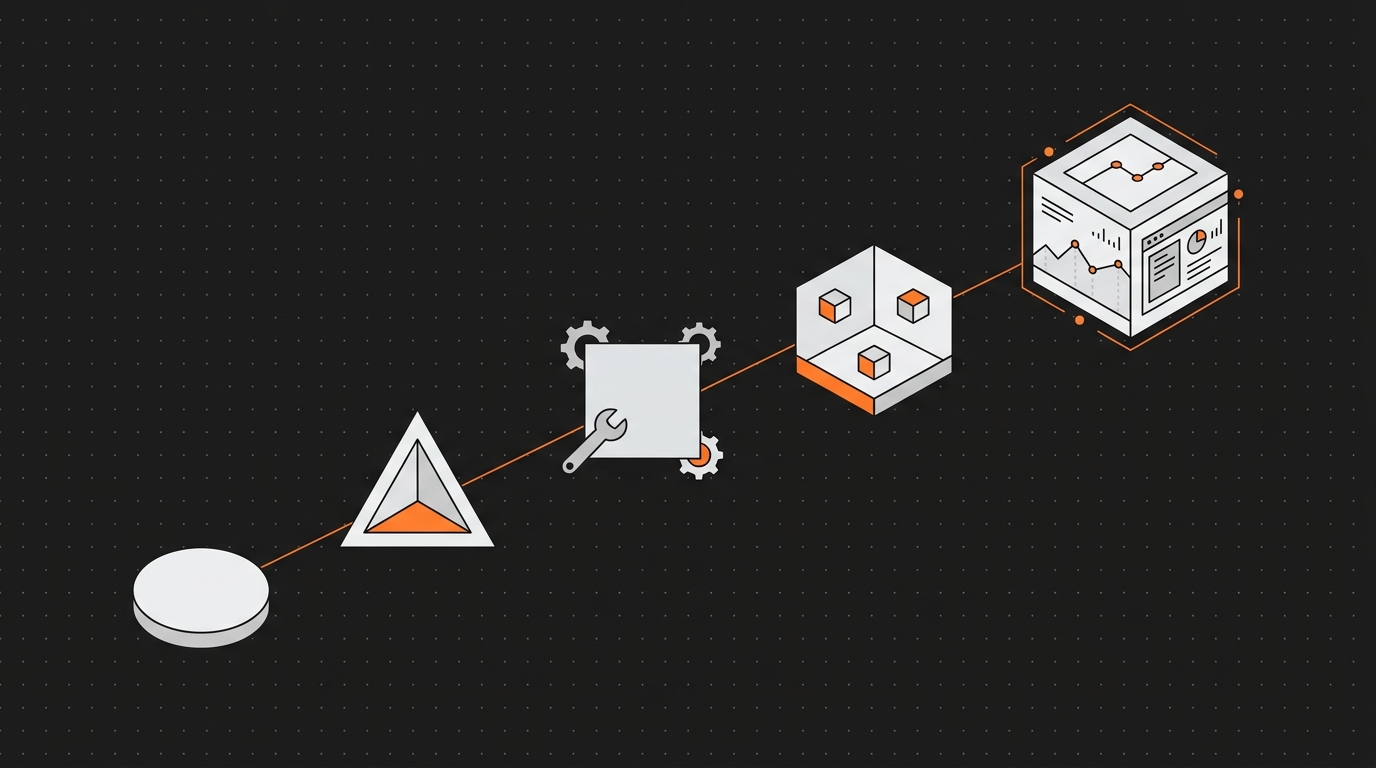

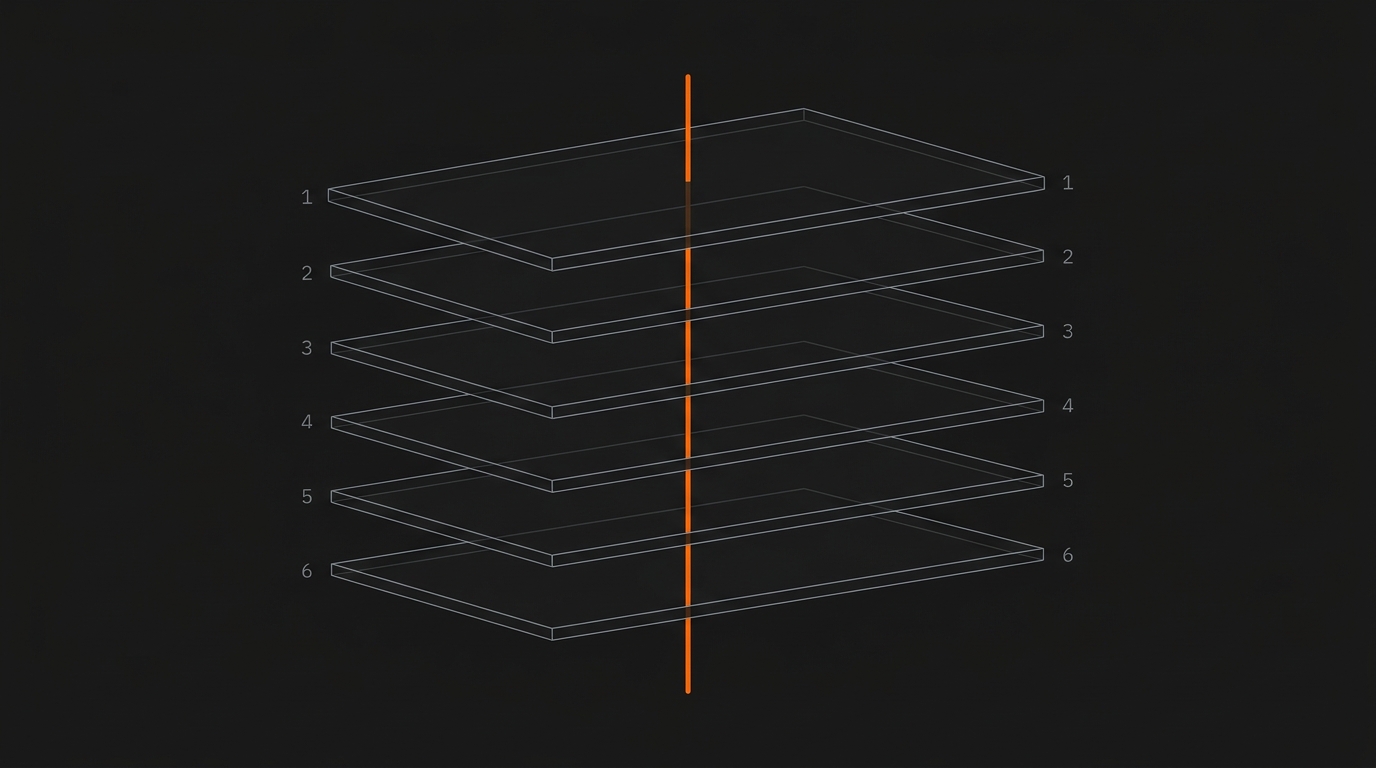

Anatomia de um harness em produção: as 6 camadas que separam POC de sistema confiável

O harness do tutorial roda. Em produção, ele morre na primeira semana. Esse post abre o capô do que entra entre o request e o response quando o agente está vivo 24 por 7: gate, roteador, contexto, loop com budget, pós-processamento e telemetria. Diagrama, código e referências reais para sair do POC e chegar num sistema confiável.

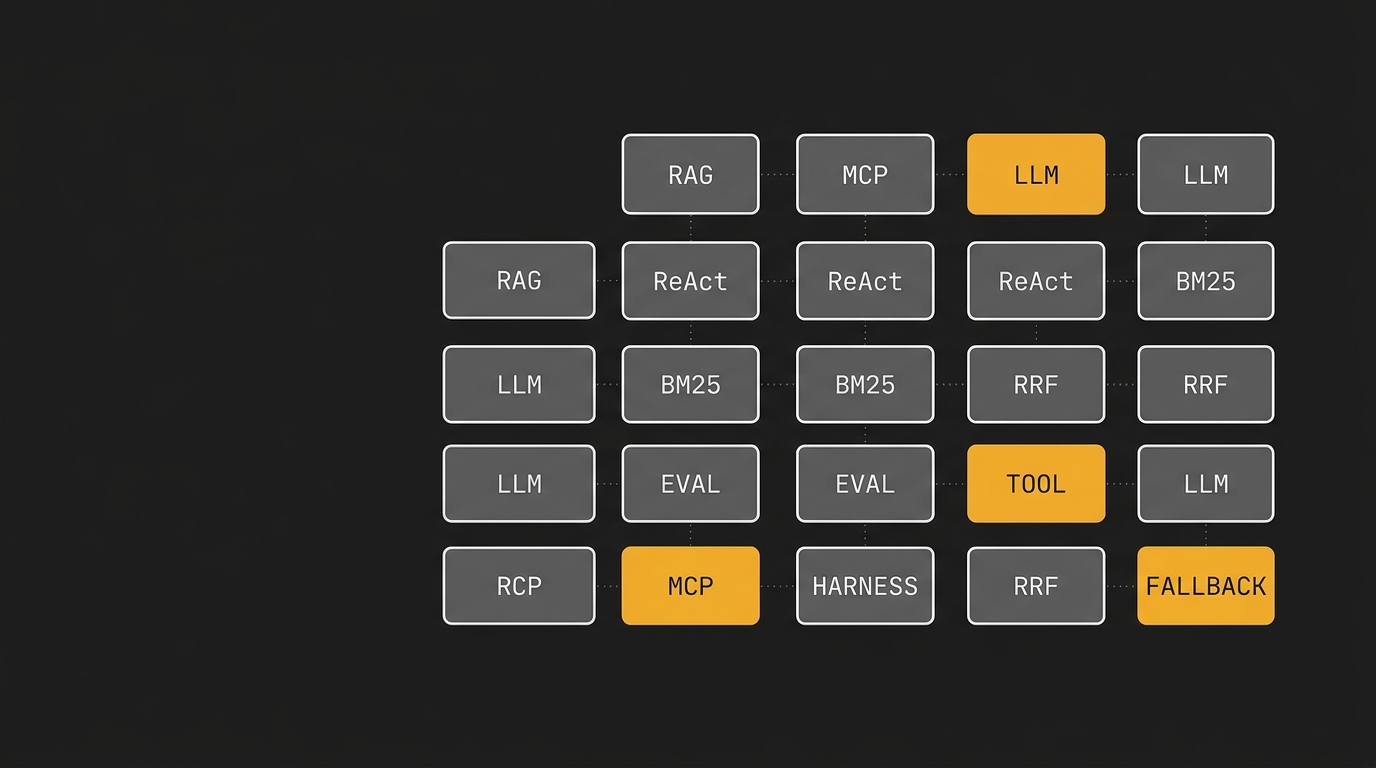

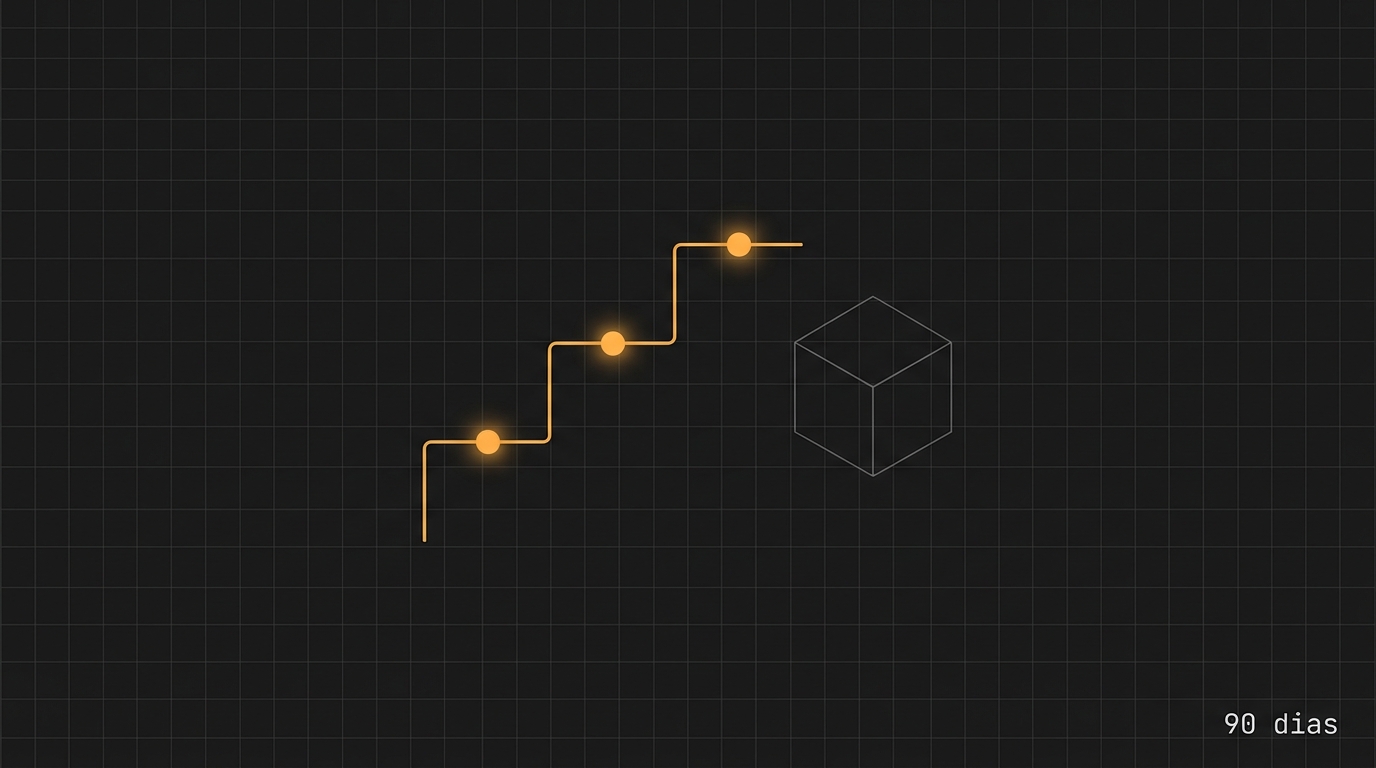

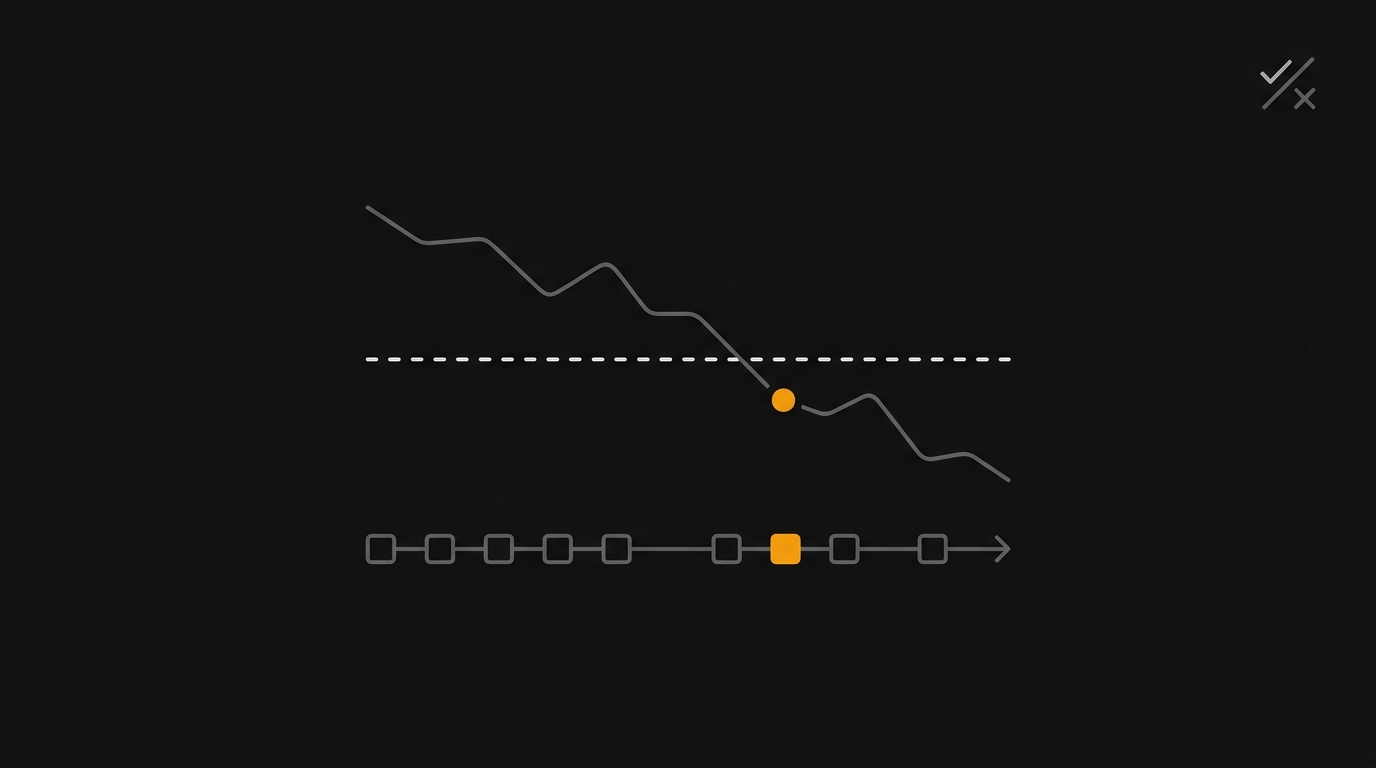

Roadmap AI Engineer em 90 dias: do dev backend ao primeiro agente em produção

Caminho real de 13 semanas para dev backend experiente virar AI engineer aplicada. Tool use, harness próprio, RAG, memória, evals e um projeto fim-a-fim que cabe no portfólio. Sem refazer fundamentos, sem detour por framework da moda. Entregáveis por semana e foco no que recrutador olha de verdade.

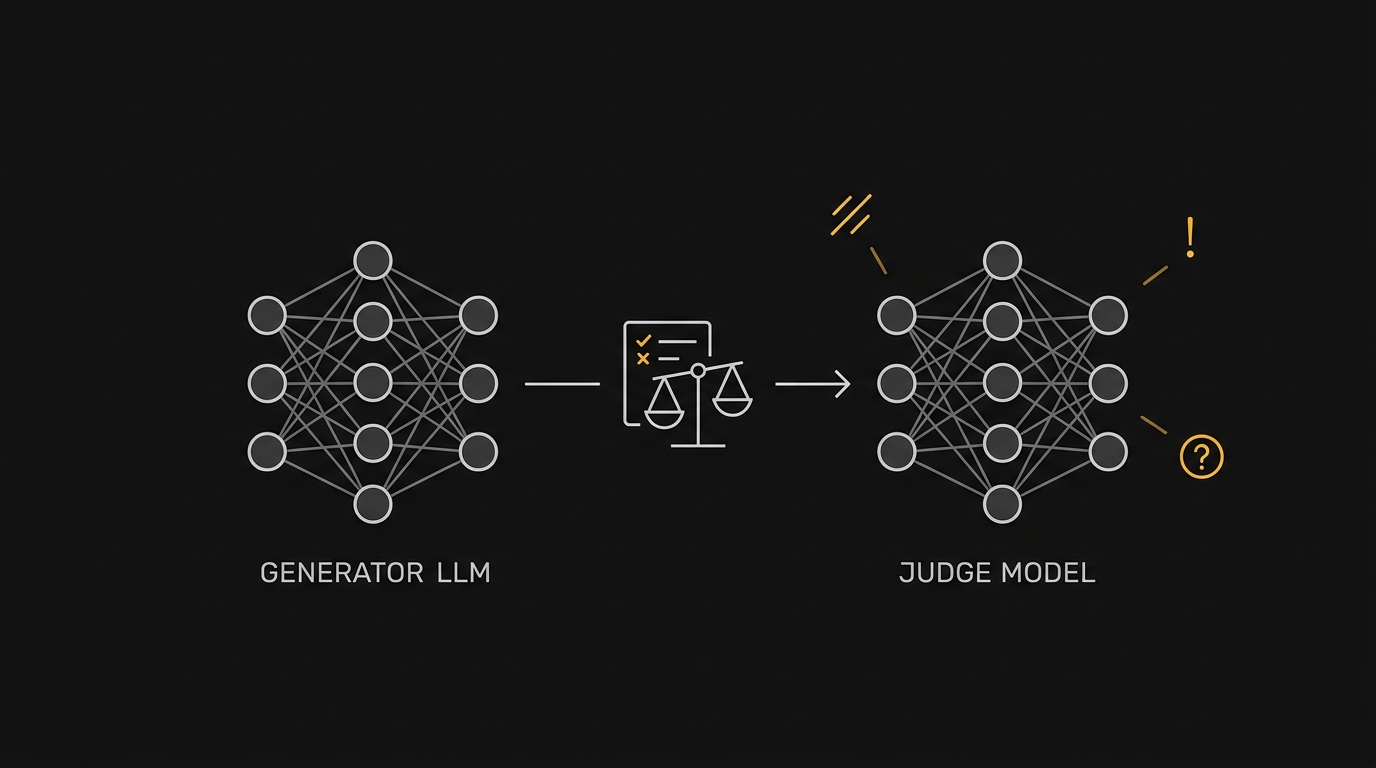

Model Graders: usando LLMs para avaliar LLMs (e os 3 erros que invalidam o seu eval)

LLM-as-judge é o atalho que todo time de IA usa pra escalar evals. Mas tem três armadilhas que silenciosamente invalidam o pipeline: self-preference, position e verbosity bias, e calibração ausente. Cobrimos os três padrões de prompt para grader (rubric, reference, pairwise) e como blindar contra cada erro com mitigação concreta.

Engenharia de contexto vence prompt engineering: por que o que você NÃO coloca no prompt importa mais

Karpathy e Lütke dispararam em 2025: o nome certo não é prompt engineering, é engenharia de contexto. Três experimentos lado a lado da mesma tarefa mostram, com tokens, dólar e testes passando, por que o que você NÃO coloca no prompt importa mais que o que coloca.

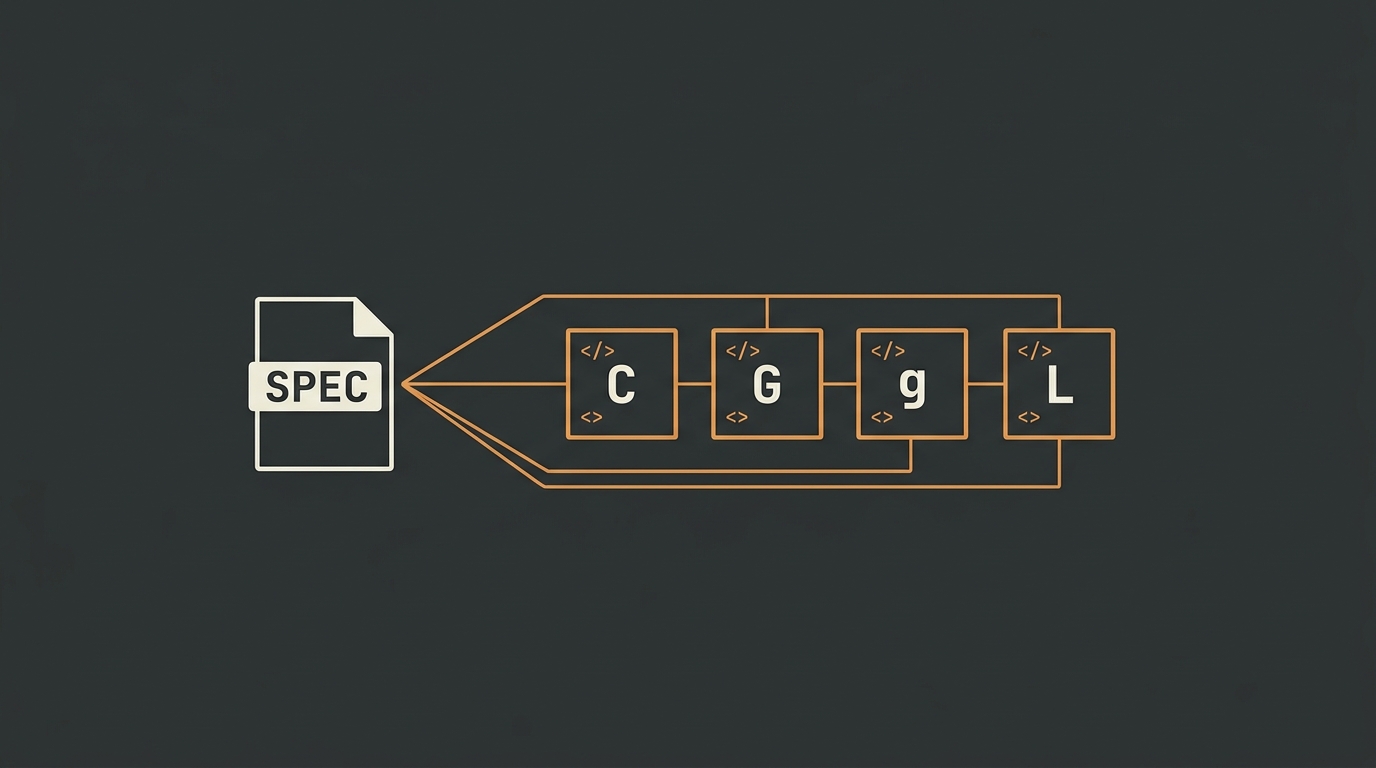

Specs como contrato com o agente: rodei a mesma spec em 4 LLMs pra ver quanto convergem

Experimento prático rodando a mesma spec em Claude Sonnet 4.6, GPT-5.1, Gemini 2.5 Pro e Llama 4 Maverick. Mede convergência via TSED e testes passados. Spec vaga deu 0,34 de similaridade entre pares; spec estruturada deu 0,78. A spec importa mais que o modelo.</excerpt> <parameter name="tags">["spec-driven-development", "sdd", "llm", "evals", "claude", "agentes", "requisitos", "testing"]

Do prompt frágil ao sistema confiável: pipeline de eval contínuo para prompts em produção

Trocou o modelo, mudou uma frase no system, ajustou um exemplo, e 30% dos casos regrediram em silêncio. Pipeline de eval contínuo no CI resolve isso. Dataset versionado, runner em cada PR, gate de qualidade que barra merge. Mão na massa com Promptfoo e GitHub Actions.

SDD vs BMAD vs Vibe Coding: qual metodologia faz sentido para seu time

Para de discutir "qual é melhor" e comece a discutir "qual cabe no seu contexto". Matriz de decisão com quatro eixos que mapeia SDD, BMAD e Vibe Coding ao quadrante onde performam.