#Prompt Engineering

Tutoriais

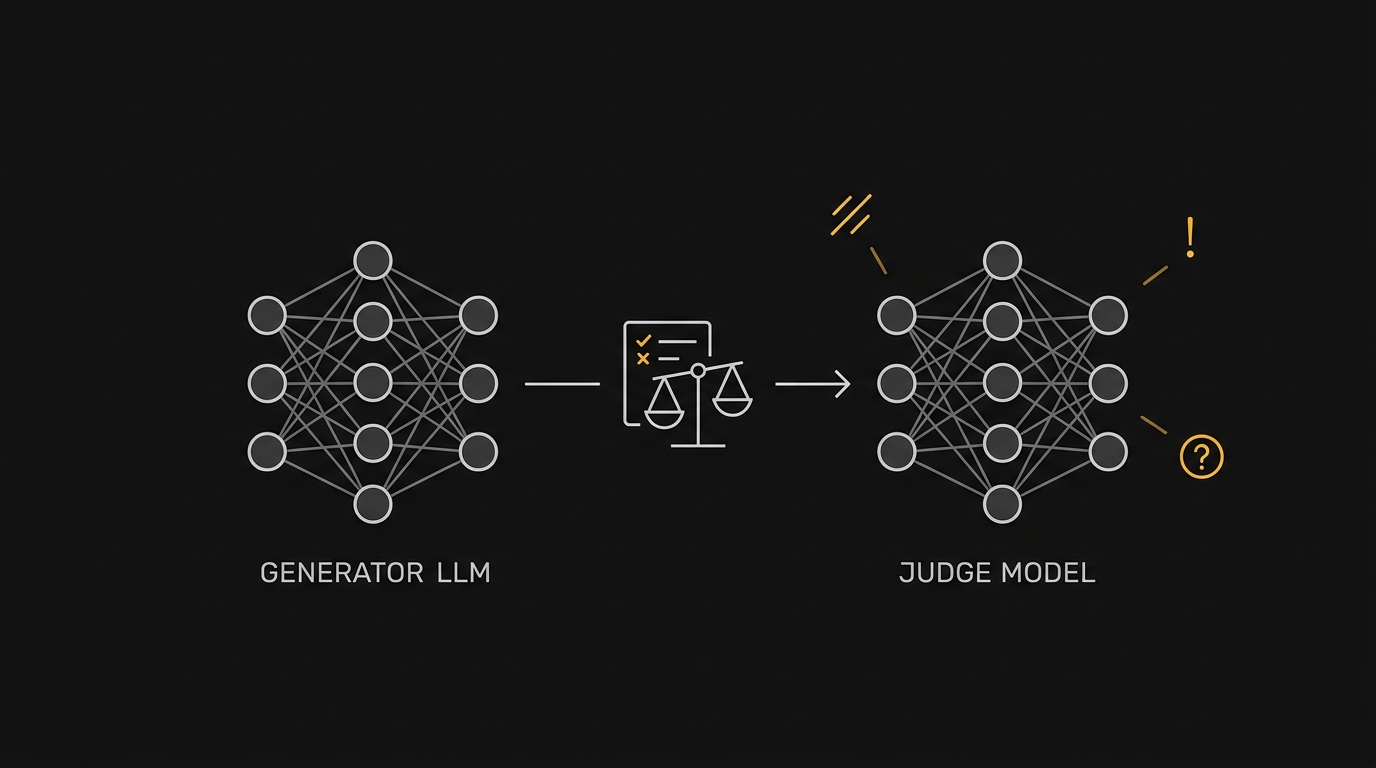

Model Graders: usando LLMs para avaliar LLMs (e os 3 erros que invalidam o seu eval)

LLM-as-judge é o atalho que todo time de IA usa pra escalar evals. Mas tem três armadilhas que silenciosamente invalidam o pipeline: self-preference, position e verbosity bias, e calibração ausente. Cobrimos os três padrões de prompt para grader (rubric, reference, pairwise) e como blindar contra cada erro com mitigação concreta.

·

12 min

·

Lucas Souza

Tutoriais

Engenharia de contexto vence prompt engineering: por que o que você NÃO coloca no prompt importa mais

Karpathy e Lütke dispararam em 2025: o nome certo não é prompt engineering, é engenharia de contexto. Três experimentos lado a lado da mesma tarefa mostram, com tokens, dólar e testes passando, por que o que você NÃO coloca no prompt importa mais que o que coloca.

·

11 min

·

Lucas Souza